Người phụ nữ bị lừa 51.000 USD vì "Elon Musk giả", hay hiệu trưởng suýt mất việc vì bị nhái giọng nói, cho thấy bất kỳ ai cũng có thể là nạn nhân của deepfake.

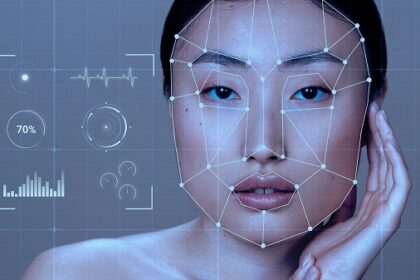

Gần đây, thuật ngữ “deepfake” được đề cập tới nhiều, đặc biệt xung quanh việc phát tán ảnh khỏa thân giả của ca sĩ nổi tiếng Taylor Swift trên X.

So với ảnh hay video, âm thanh tạo bởi AI được đánh giá là khó phát hiện nhất, gây lo ngại trong việc phát hiện nội dung giả mạo.